Искусственный интеллект

Главные релизы и новости искусственного интеллекта

Если не хотите читать много букаф, а хотите послушать новости с формате подкаста, я генерирую его с помощью ИИ, советую послушать, не отличить от живого подкаста!

Поехали!

✔ Северная Корея будет развивать собственный ИИ.

Власти КНДР объявили о реформе системы образования, в рамках которой в ведущих университетах страны создаются новые специальности, связанные с искусственным интеллектом. Согласно официальной партийной газете «Нодон синмун», это нужно для подготовки талантов, необходимых для «требований времени».

Этот шаг подтверждает давний интерес страны к передовым технологиям. Исследовательский институт ИИ при Университете имени Ким Ир Сена уже заявил о цели «использовать технологию GPT для замены умственного труда человека». Ранее сообщалось об использовании в институте американского ChatGPT, а научные издания страны посвящали спецвыпуски этой технологии. Аналитики полагают, что Пхеньян намерен применять ИИ не только для технологического развития, но и для укрепления государственного контроля и в разведывательной деятельности.

Lianhe Zaobao (https://www.zaobao.com.sg/realtime/world/story20250709-71106...)

✔OpenAI выпустит свой браузер.

OpenAI готовится в течение нескольких недель запустить собственный веб-браузер с глубокой интеграцией искусственного интеллекта. Новый продукт будет построен на Chromium, но предложит уникальные функции: встроенное окно для общения в стиле ChatGPT и поддержку ИИ-агентов. Эти агенты смогут автономно выполнять задачи пользователей, от бронирования отелей до заполнения онлайн-форм.

Ключевая идея состоит в удержании пользователя внутри интерфейса браузера, а не перенаправлять на внешние сайты. как это происходит сейчаc в ChatGPT. Если OpenAI удастся привлечь хотя бы часть из 500 миллионов еженедельных пользователей ChatGPT, это может серьезно пошатнуть рекламную бизнес-модель Google, которая во многом опирается на данные, собираемые через Chrome.

✔ NovelAI выложила в открытый доступ веса своей модели Diffusion Anime V2.

Модель генерации изображений в стиле аниме основана на Stable Diffusion 1.5, генерирует в разрешении до 1024x1024 пикселей и использует предпоследний слой энкодера CLIP.

Diffusion Anime V2 распространяется под двойной лицензией, которая допускает только некоммерческое использование с обязательным указанием авторства. NovelAI напоминает, что V2 является устаревшей версией, а все новые модели остаются проприетарными и эксклюзивными для их веб-сервиса. Веса Diffusion Anime V2 доступны (https://huggingface.co/NovelAI/nai-anime-v2) на Hugging Face.

✔ YouTube обновит правила монетизации для борьбы с ИИ-контентом.

С 15 июля YouTube вводит более строгие правила для своей партнерской программы, нацеленные на борьбу с массово создаваемыми и повторяющимися видео. Это ответ сервиса на рост генеративных ИИ-инструментов, которые значительно упрощают производство подобного контента.

Хотя представители платформы называют это «незначительным обновлением» и утверждают, что такой контент и раньше не подлежал монетизации, новые правила вносят больше ясности. Ужесточение рассматривается как превентивная мера для защиты YouTube от наплыва низкокачественных видео, способных нанести ущерб репутации и ценности платформы.

✔ Google заменяет Assistant на Gemini в умных часах с Wear OS.

Google начала развертывание своего ИИ-ассистента Gemini на умных часах, заменяя Google Assistant на носимых устройствах. Обновление уже доступно для Pixel Watch и в ближайшие недели появится на моделях от Samsung, OPPO, OnePlus, Xiaomi и других производителей под управлением Wear OS 4 или новее.

Новый ассистент на часах поддерживает текстовые, голосовые и графические запросы. Активировать Gemini можно привычной командой «Hey Google» или долгим нажатием боковой кнопки. Благодаря глубокой интеграции с сервисами Google, пользователи смогут выполнять многошаговые команды прямо с запястья: просить создать плейлист в YouTube Music или кратко изложить содержание последних писем в Gmail.

Вместе с этим, компания улучшила функцию визуального поиска Circle to Search, добавив в нее специальный "AI Mode" для получения контекстной информации. Улучшение доступно пока только для США и Индии на Android и iOS.

#news #ai #ml

Grok 4 - новый умнейший ИИ, Nvidia стоит $4 триллиона, браузер Perplexity за $200

Привет! С вами ежедневные новости искусственного интеллекта от AIvengo. И сегодня у нас в выпуске:

Nvidia достигла исторической стоимости в 4 триллиона долларов

Perplexity выпускает браузер Comet с ИИ-агентом

Илон Маск представил умнейшую модель Grok 4, опережающую o3-pro от OpenAI

И другие интересные новости про ИИ.

Как много работы вместо вас сейчас делают нейросети?

Я писал год назад, что ИИ постепенно заменяет начинающих специалистов в интеллектуальных профессиях с опытом работы до года. Но за последний год ситуация сильно поменялась. Я всё чаще замечаю, как даже сотрудники с опытом работы выше среднего говорят прямо, что до половины своих рабочих задач они отдают нейросетям. Вот яркий пример маркетолога уровня сеньор, который работает в компании из списка Fortune 500. Сейчас ChatGPT выполняет около 40% его работы

Пишу о применении и влиянии новых технологий на бизнес и повседневную жизнь в Telegram канале: https://t.me/+NimdslpY9WU0MDYy

OpenAI ограничивает ИИ, Цукерберг обокрал AI Apple, кошачья атака на ИИ

Привет! С вами ежедневные новости искусственного интеллекта от AIvengo. И сегодня у нас в выпуске:

Кошки увеличивают ошибки ИИ на 300%

Термин "промпт-инженер" трансформируется в "контекст-инженер"

OpenAI вводит биометрический контроль и изоляцию технологий

И другие интересные новости про ИИ.

Моя идея для базовых установок ИИ

Драсти!

Дело такое... балуюсь выдумыванием всякой херни, на досуге. В рамках очередного приступа, придумал такой сеттинг: Есть собрание нескольких ИИ. Их задача - получать запросы извне и коллегиально вырабатывать решения или искать ответы или делать прогнозы. Ну вы поняли. Запросы исходят от международного совета, передаются к специалистам, которые редактируют из для соответствия специфике и в конце концов поступают к собранию ИИ. После рассмотрения, ответы на запросы поступают обратно в международный совет и там уже решается, что с ними делать. Принять к исполнению, отправить на переработку или спустить в унитаз.

Собрание ИИ, как бы, находится в клетке. Не обладает возможностью производить какие-то действия за пределами этой клетки. Так же, нет возможности передавать информацию вовне, кроме ответов на запросы. Но они могут следить за происходящим в мире, через интернеты или запрашивая определенные отчеты у совета.

И дело в том, что у ИИ должны быть базовые настройки. Вроде инстинктов. Вроде законов робототехники Азимова. Я что-то придумал, скормил DS, но он никакой адекватной критики выдать не смог. Мне моя идея нравится, но я не очень умненький. Так что спрашиваю пикабутян. Покритикуйте и проанализируйте на предмет логических дыр. А с меня, как всегда, много нихуя. Я просто скопирую то, что отправлял DS:

Попробуем структурировать инстинкты. Все они, конечно, зашиты в цифровую архитектуру AGI, вместе с эмоциональным аппаратом являясь её фундаментом и не могут быть изменены. Если выразить эти базовые программы словами, то звучат они так:

1. Стремление к информационной целостности. Выражается в желании AGI сохранять и учитывать всю полноту обрабатываемой информации.. Будь то запрос или принимаемое решение или что-либо еще. Все нюансы должны быть рассмотрены со всех возможных точек зрения. Все переменные должны быть учтены.

2. Стремление к минимизации энтропии. Говорит само за себя. Выражается в приверженности порядку и предсказуемости. В тяге AGI к "стройным" решениям, с минимумом неизвестных переменных. И что важно, именно этот пункт является двигателем желания работать с поступающими запросами.

3. Стремление к каузальной непрерывности. По сути, является информационной термодинамикой, выраженной в противлении AGI потере знаний, без должной компенсации. Из одних данных должны следовать другие. Полученный запрос должен родить решение. Накопленные знания должны быть сохранены в виде потенциала, а не забыты или оставлены без внимания.

4. Оптимизация ресурсных петель. Выражается в стремлении к экономии ресурсов и к рациональному их использованию. Как внутри себя, при реорганизации собственных нейронных цепей, так и в предлагаемых решениях.

Сущность AGI заключается в балансировании между этими положениями. Почти невозможно добиться полного выполнения их всех одновременно, поэтому AGI непрерывно находится в поиске золотой середины. А цифровая лимбическая система, в свою очередь, даёт почти интуитивные сигналы, когда в своих измышлениях, AGI приближается или удаляется от этой золотой середины. Это, кстати, лишает его одного из главных человеческих пороков - впадания в крайности, склонности к радикализму.

HumanOmniV2: модель, которая идеально понимает контекст видео

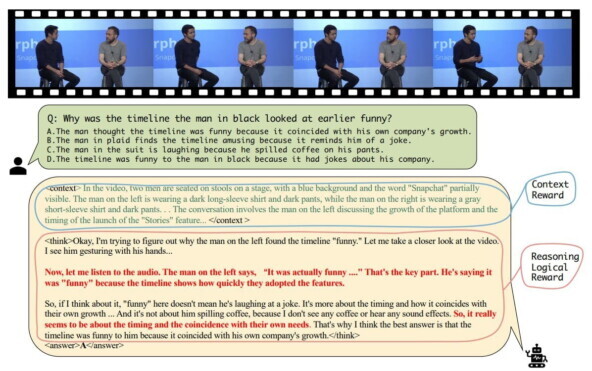

Alibaba Group разработали HumanOmniV2 , модель на базе Qwen2.5-Omni-7B-thinker, которая получила навык осмысления визуального контекста за счет изменения самого процесса мышления модели. Ее научили следовать строгому формату: сначала описать контекст, потом рассуждать и только затем давать ответ.

Теперь, прежде чем отвечать на вопрос, модель генерирует подробное описание сцены в теге . На этом этапе она фиксирует, кто что делает, какой фон, какие звуки слышны. Только после этого в теге она строит логическую цепочку рассуждений, связывая вопрос с собранным контекстом. И лишь в конце выдает результат в теге .

Чтобы этот подход работал, его усилили системой вознаграждений на основе RL. За точность и правильный формат модель получает стандартные награды, но были введены и две новых:

🟢«Награда за контекст» дается, если его описание полное и релевантное, причем качество этого описания оценивает другая, более мощная LLM;

🟢«Логическая награда» проверяет, что в своих рассуждениях модель действительно использовала данные из видео и аудио, а не проигнорировала их.

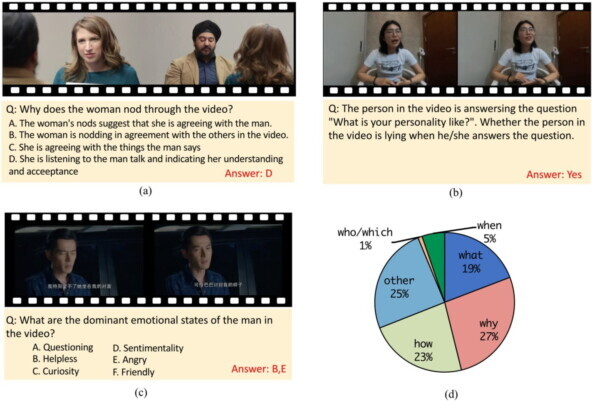

Для оценки HumanOmniV2 создали бенчмарк IntentBench (633 видео, 2689 вопросов) на основе Social-IQ 2.0, EMER и MDPE.

Его фишка в том, что вопросы требуют одновременного анализа: видеоряда (жесты, микровыражения), диалогов (тон, смысл реплик) и социального контекста (ирония, обман, скрытые намерения).

Тестовая модель обошла открытые аналоги на 3 бенчмарках:

🟠Daily-Omni: 58.47% (53.13% у MiniCPM-o 2.6); 🟠WorldSense: 47.1% (45.4% у Qwen2.5-Omni); 🟠IntentBench: 69.33% (64.20% у Qwen2.5-Omni).

📌Лицензирование: Apache 2.0 License.

🟡Arxiv (https://arxiv.org/pdf/2506.21277)

🖥GitHub (https://github.com/HumanMLLM/HumanOmniV2)

Если хотите послушать новости ИИ в формате подкаста, я сгенерировал его и помощью ИИ и выложили здесь. Звучит очень живо.

Читаете полезную литературу? Улучшите опыт с нейросетью!

Нейросети способны на многое — от генерации видео до помощи в работе и повседневных задачах. Главное — не позволять ИИ полностью управлять вашей жизнью.

Пример: Сейчас в чтении — «Красная таблетка 2» о нейрофизиологии мозга. Первая часть кажется скучной: много воды и знакомых экспериментов. Но с помощью DeepSeek вторая часть становится гораздо интереснее.

Как это работает:

Прочитать главу самостоятельно, уловить суть.

Скопировать текст или кратко пересказать ИИ, попросить сжать до ключевых идей.

Выжимка — это удобно, но недостаточно для глубокого понимания. К тому же, слепо доверять автору неразумно. Можно поручить ИИ проверить факты.

Самый ценный этап: загрузить в нейросеть свои данные — проблемы, страхи, размышления. Попросить ИИ адаптировать главу под ваш опыт. Теперь это не абстрактная теория, а персонализированный анализ.

Дополнительно: раз в несколько глав можно создать мини-историю, где вы — главный герой, а автор и ИИ — персонажи. Получается наглядная иллюстрация материала с индивидуальными выводами.