Ответ на пост «Пользователь создал скрипт который позволяет создавать DeepFake в один клик. Качество как по мне отличное и превосходит предыдущие решения»9

В поддержку предложения @MorfixProton про авторский контент.

Deepfake в один клик? В комментах писали, что "в один клик" и "установите тут python, там pip, здесь git, ffmpeg, шкуру бумсланга, рог единорога, затем полейте росой, собранной с 05:59 до 06:01 утра счатливой индийской девушкой" – это всё-таки разные вещи. Поэтому я подвёз docker-образ, который сделает всё за вас (пока что только CPU версию).

Да, тоже придётся покликать. Но чуть меньше XD

Ссылка на docker-hub'е: https://hub.docker.com/repository/docker/axmaaa/roop-basic/g....

Использование.

Linux: установите Docker Desktop с официального сайта. Windows: установите Docker Desktop с официального сайта.

Откройте терминал/командную строку, перейдите в директорию с нужным фото и видео, которое хотите обработать.

Выполните: docker run -it --mount type=bind,src=.,dst=/roop_examples axmaaa/roop-basic:1

Можете пока покушать, первый раз будет большо-о-ое скачивание.

Текущая папка будет примонтирована в /roop_examples в контейнере, и там будут ваши фото и видео. То есть в открывшейся консоли вы можете запускать roop, указывая фото и видео через параметры командной строки, например: python3 run.py --face /roop_examples/photo1.jpg --target /roop_examples/video1.mp4 --output /roop_examples/output1.mp4 – соответственно, меняете photo.jpg, video.mp4 и output1.mp4 на нужные вам файлы.

После завершения программы результат должен появиться в вашей текущей папке на компьютере.

Сборка.

OpenSource – великая вещь, поэтому если кто-то не доверяет мне))) хочет собрать образ сам, можно взять Dockerfile с моего репозитория на github.

Вам понадобится inswapper_128.onnx из оригинального поста.

Также нужен архив buffalo_l.zip – его можно скачать с github deepinsight, он нужен, чтобы не скачивать одни и те же 275 МБ каждый раз при запуске контейнера.

Поместите эти файлы в папку с Dockerfile, перейдите туда в терминале, после чего выполните: docker build -t roop-basic:my . -f Dockerfile-basic

Можете пока поспать, сборка будет долгой.

После сборки, по аналогии с предыдущей инструкцией, запускаете командой docker run -it --mount type=bind,src=.,dst=/roop_examples roop-basic:my

Особенности.

Я не гуру docker, вполне мог что-то упустить. Если что заметите – обязательно пишите.

Образ весит 10 ГБ – довольно много. Но ненамного больше, чем весят все python-пакеты, inswapper_128.onnx, модели buffalo, и т. д.

Пока что, как я уже говорил, версия только для CPU. Сейчас работаю над версией для видеокарты NVIDIA.

Проверял работоспособность только под Linux, инструкцию писал из соображений, что под Windows всё должно быть аналогично. Возможно, это не так – в таком случае тоже напишите об этом, пожалуйста.

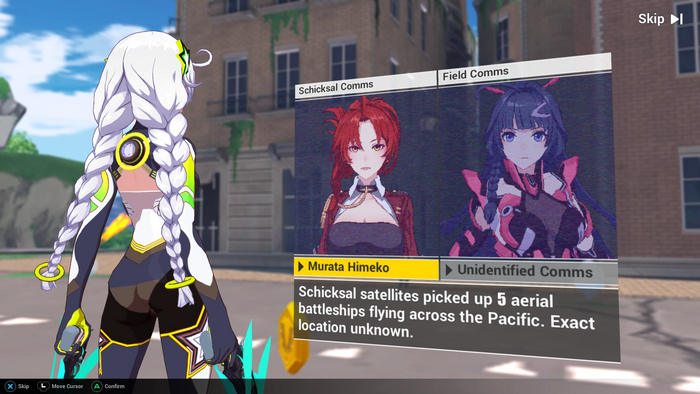

UPD: по просьбам трудящихся – вот вам для примера Джейсон Меня Не Убить Стэтхем.