Искусственный интеллект

Как я научился плодить посты на Пикабу с помощью нейросетей (и теперь делюсь лайфхаками, чтобы вас тоже забанили за спам)1

Привет, пикабушники! Сегодня расскажу, как из человека, который два абзаца связать не может, превратиться в конвейер по производству постов. Секрет? Нейросети. Да, те самые штуки, которые уже пишут курсовые за студентов и рисуют котиков в скафандрах.

**Шаг 1: Генерируем идею**

Не знаете, о чём писать? Спросите у ИИ! Например, пишем в ChatGPT:

— «Придумай 5 абсурдных тем для поста на Пикабу про бытовуху».

Ответ:

1. «Как я случайно приготовил борщ в стиральной машинке».

2. «Диалог с тараканом, который требует плату за аренду угла под холодильником».

3. «Почему моя кошка считает Wi-Fi-router своим личным троном».

**Шаг 2: Пишем текст**

Берём тему и говорим нейросети: «Напиши смешную историю от лица студента, который пытался починить кран, но затопил соседа-дальтоника, и теперь тот думает, что потоп — это инсталляция современного искусства».

**Шаг 3: Добавляем мемы**

Картинки генерим через MidJourney или Kandinsky:

— «Кот в космическом шлеме ест пельмени на фоне горящего мультиварки».

Готово! Теперь у вас не пост, а шедевр абсурда.

**Шаг 4: Человеческий финальный штрих**

Нейросети иногда выдают текст, как у робота-зануды. Добавьте:

— Свои шутки (типа «спасибо, ChatGPT, ты как старший брат, который умнее меня, но без чувства юмора»).

— Опечатки (чтобы все поверили, что это реальная история).

— Вбросы про «ПыСы: жена не оценила».

**Важно!**

— Не доверяйте ИИ слепо: если нейросеть советует «добавить в пост криптовалюту и политсрач» — это плохая идея.

— Пишите так, будто нейросеть — ваш кореш, который помогает придумать приколы, но не более.

А вы пробовали генерить посты через ИИ? Или боитесь, что нейросеть отнимет у вас единственную радость в жизни — минусы на карму? 🚀

*P.S. Если этот пост написал ChatGPT, ставьте плюсик, чтобы он почувствовал себя нужным. Если я — живой человек… тоже ставьте. А то обидно будет.* 😄

Нейронка для pdf

Нейронка извлечет ЛЮБЫЕ данные из PDF-документа — можно легко вытащить даже сложные графики, таблицы или макеты, которые просто так скопировать невозможно.

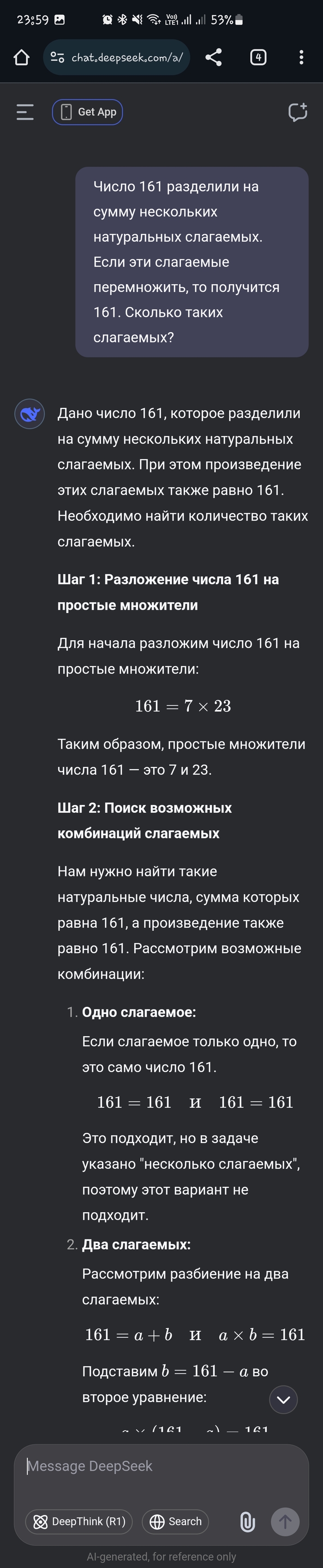

DeepSeek УКРАЛИ ChatGPT2

DeepSeek УКРАЛИ ChatGPT — OpenAI утверждают, что у них есть доказательства того, что китайцы тренировали свою модель на наработках американцев.

Если простыми словами: DeepSeek взяли OpenAI o1 и заставили её учить свою модель быть умной. Из-за этого DeepSeek часто называет себя ChatGPT и цитирует правила OpenAI.

Ждём от Альтмана железобетонных пруфов.

Нейросети-философы: почему DeepSeek обрушил рынок, а умный Claude не может сверстать страницу

Пока все обсуждают обвал акций tech-гигантов из-за китайской нейросети DeepSeek, давайте поговорим о действительно интересном - как ребята из Ханчжоу научили искусственный интеллект думать вслух

Что умеет новая нейросеть?

DeepSeek не просто отвечает на вопросы, а показывает весь процесс "размышлений", параллельно исследуя интернет. Выглядит это примерно как визит к психотерапевту, который комментирует ваши проблемы в третьем лице: "Пациент спрашивает про криптовалюты, давайте посмотрим, что об этом пишут на форумах..."

Как человек, который три года экспериментирует с нейросетями, могу сказать - качество контента впечатляет. Проверка через биржу etxt показала 99% уникальности. Платные конкуренты едва дотягивают до 96%.

В чем фишка китайского самородка:

🌐 Работает без VPN

💰 Бесплатная версия

🧠 Показывает ход мыслей

🗣 Понимает человеческую речь

🔍 Ищет информацию даже в китайском сегменте интернета. Вы можете бодяжить свой рерайт китайскими мудрыми мыслясми

И никаких ритуальных плясок с бубном. Помните истории сотрудников Яндекса про то, как они говорят Алисе "ты справишься, ты умная. Извини плиз"? Здесь такой цифровой психотерапии не требуется.

Техническая начинка

DeepSeek - детище китайской компании, основанной в 2023 году миллиардером Ляном Вэньфэном. Используют архитектуру Mixture-of-Experts с 256 "экспертами" и технологию Multi-head Latent Attention. По-простому: представьте 256 профессоров в одной голове, которые одновременно анализируют ваш вопрос.

Как начать пользоваться?

Заходите на deepseek.com

Нажимаете "Start Now"

Регистрируетесь через email или Google

P.S. Сервис иногда закрывает регистрацию из-за наплыва желающих, но это временно.

Убьет ли DeepSeek ChatGPT?

Китайский новичок действительно впечатляет, особенно в программировании. Но ChatGPT тоже не стоит на месте - запускает собственных ассистентов, развивает Sora для создания видео и canvas-интерфейс для разработчиков. У многих там отлажены процессы и странно, что люди все бросят, что бы сэкономить 20 у.е

На фоне шумихи вокруг DeepSeek и его способности "думать вслух" стоит поговорить о том, когда эта чрезмерная умность реально полезна, а когда напоминает попытку забить гвоздь микроскопом. Например, новый умный Claude не справляется с задачей заверстать хтмл страницу. Он постоянно чего то забывает. И нужно править. А простые его старые модели без ума справляются.

Когда нейросети слишком умничают: руководство по применению DeepSeek и других умников

На фоне шумихи вокруг DeepSeek и его способности "думать вслух" стоит поговорить о том, когда эта чрезмерная умность реально полезна, а когда напоминает попытку забить гвоздь микроскопом.

Когда действительно нужны рассуждения:

🏥 Медицинские кейсы: Загружаете все анализы, и нейросеть помогает составить грамотные вопросы для врача. Особенно полезно, когда счет за лечение вызывает больше вопросов, чем само лечение

⚖️ Юридические головоломки: Разбор договоров, поиск прецедентов, анализ рисков. Тут без глубокого анализа никак

🎯 Стратегическое планирование: Когда нужно просчитать несколько сценариев развития событий, учитывая десятки факторов

🎨 Разработка стратегии : Генерация контента с пониманием темы, а не просто пересказ первой страницы из Google

А вот где все эти умные рассуждения явно лишние:

🔢 Простая математика: Калькулятор не философствует о природе чисел, просто выдает результат

🐱 Распознавание базовых объектов: Определить кота на фотографии может даже нейросеть времен первого iPhone

P.S. Для тех, кто все еще сомневается:

Старые добрые "простые" нейросети никуда не денутся. Они как старый добрый "Запорожец" - может, не такой навороченный как Tesla, зато надежный и бензина почти не ест. Они прекрасно справляются с базовыми задачами, делая это быстро и без лишних затрат на электричество. Кстати, сейчас не заслужено обходят факты запуска P.S. О чем все забыли в погоне за хайпом

Забавно наблюдать, как все обсуждают DeepSeek, но почему-то игнорируют Google AI Studio с их обновленной моделью Gemini-2.0-Flash-Thinking-Exp-1219. А ведь она теперь может рассуждать на миллион токенов - это в 30 раз больше, чем раньше и 10 раз больше чем deepseek. Получается, бесплатная модель от Google даёт возможность вести более глубокие дискуссии чем Deepseek

Кстати, о бесплатных моделях с большим контекстным окном - китайцы не отстают и выкатили Qwen2.5-Plus c контекстным окном в 1 млн токенов. Туда можно загрузить без раздумий 100 тысяч ключевых слов.

В общем, прежде чем гнаться за очередным хайповым релизом, стоит посмотреть по сторонам - возможно, нужный инструмент уже есть, просто о нем пока не кричат на каждом углу.

22 года в маркетинге, 3 года с нейросетями и куча инсайтов из преподовательской практики - все это без хайпа и воды в моем телеграм.

РП с нейросетью. Общайся со своей вайфу о чем угодно. Часть 1: легкий вкат

Нейросети развились до такой степени, что с ними можно проводить время и выстраивать ролевые сюжеты. Этот текст - попытка заинтересовать вас войти в мир РП, в частности РП с нейросетью в интерфейсе SIllyTavern.

Что такое этот ваш ролеплей вообще?

Да в целом все просто. Есть персонаж с прописанным бекграундом, сюжетом и завязкой. На основе этой завязки ты пишешь свой текст, потом ИИ тебе отвечает в рамках сюжета, и так далее и так далее.

Что привлекает в ИИ-ролеплее? Ну во-первых, у тебя всегда есть собеседник. Персонажей тысячи, на любой вкус и цвет. А если нет того, который бы тебя устраивал - просто напиши своего, это не очень сложно.

Во-вторых - максимальная свобода. Тут реально царит тотальная анархия в плане цензуры, начиная с самих моделей ИИ, заканчивая персонажами. И во славу Плети, что до комьюнити ИИ-ролеплея еще не добрались цензоры, очень чувствительные персоны с тонкой натурой или обостренным чувством справедливости.

Нет, я серьезно, ты можешь делать вообще ВСЕ, вплоть до откровенно жесткой чернухи, и нейросеть, не обремененная цензурой это спокойно отыграет.

Первая страница chub.ai. Извращенцы

Чтобы вы сразу поняли, чего стоит и не стоит ждать от ИИ-ролеплея. Вы не получите длинную историю (upd: без углубления в тему), 8-месячный отыгрыш внутри гильдии с кучей игроков и глубоким лором, как в варкрафте в былые времена ждать не стоит, к сожалению. ИИ-персонаж "живет" максимум где-то 200-250 сообщений в чате. Это примерно 2-4 часа, в зависимости от длины сообщений.

В среднем у меня получались истории на час-полтора, потому что я конченый виабу, который просто хочет покутить со своими вайфу. Если персонаж очень хорошо прописан, а модель очень мощная, то можно растянуть ролеплей хоть до бесконечности, но это очень вряд ли получится, и так или иначе старые детали он будет постепенно забывать.

Локальный запуск

Есть два основных способа заставить SillyTavern работать. Либо подключить ее в локальной модели (с помощью либо oobabooga, либо CoboldCPP), которая запускается на твоем ПК, либо подключаться к облачным решениям, которые дают тебе намного большую скорость и огромный выбор достаточно тяжелых моделей, которые на ПК надо еще постараться запустить. Собственно, плюсы и минусы каждого из решений:

> Локальный запуск

Все на вашей печке, но нужны мощности. Лично я давно забил на расчеты на видеокарте, потому что 8Гб ну вообще не хватает, поэтому мои модели работают на процессорных вычислениях - Ryzen 5600X и 32 Гб памяти. 16 тоже норм, но больше - лучше.

Собственно, для локального запуска моделей есть два самых популярных интерфейса - Oobabooga и KoboldCPP. Второй и будет рассматриваться в этой статье, потому что он - проще, но ничуть не хуже.

> Облако

Облачные вычисления - это круто! Но есть и ложка дегтя в этой бочке меда. В посте будет фигурировать Together.ai.

Вы сможете запускать очень тяжеловесные модели. Они даже обещают новую Llama 3.1 на 405 миллиардов параметров. Я использую в основном 70b модели (которые на реальном железе требуют около 64Гб ОЗУ вместе с контекстом и т.д.)

Очень быстрый ответ от серверов. От мощной модели, которая на вашем ПК варила бы ответ минуты 3, от together вы будете получать примерно за 10 секунд. Круто? Круто!

Дается стартовый депозит в $5. Его хватит на 2-3 дня активной игры на тяжелой модели. Дальше - либо по новой создавать аккаунт (Google), либо быть добропорядочным.

Вычисления облачные, а значит вся та чернуха, что ты делаешь со своей фентези-жертвой в фентези-подвале, будет течь по проводам прямо на сервера Together.ai, и я не знаю, насколько они конфиденциальны.

В общем насчет того самого - на свой страх и риск, но навряд ли кому-то интересно, что ты там делаешь и как извращаешься.

Собственно, для локального запуска инструкции довольно простые, просто качайте exe-шник с последнего релиза. Но выбирайте с умом:

KoboldCPP_cu12 - для поддержки видеокарт NVIDIA RTX (c CUDA ядрами)

koboldcpp_nocuda - если не нужно использовать CUDA (Карты Intel или NVIDIA GTX)

koboldcpp_oldcpu - старые процессоры

Для видеокарт AMD - форк от YellowRoseCx

Для Linux - инструкция, дальше сами. Удачи!

Хоть KoboldCPP и работает с моделями GGUF, но видеокарта может подхватывать вычисления и ускоряет их, так что выбор правильного файла тут действительно важен.

Как только exe-шник запущен, перед вами будет вот такая картина:

Вообще, можно даже никуда не лезть больше, просто нажимаете Browse, выбираете модель и нажимаете Launch. Да, все так просто. Подробно будет в других частях этого цикла.

Моделей куча, сотни, тысячи! И каждая подходит для своих разных задач. Давайте пробежимся по их характеристикам, чтобы вы поняли, а что вообще надо искать и как:

Ищите GGUF модели. Это указано в названии. Это модели, использующие в основном процессорные вычисления. (Есть GGML модели, опирающиеся онли на видеокарту)

Чем больше циферок с буквой "b", тем лучше. Это количество так называемых параметров, которых хранит в себе модель.

Грубо говоря:

- Если у вас 8 Гб ОЗУ, ищите 7b модели. Они немного туповаты, но под пиво пойдет

- 16 Гб ОЗУ - уже можно смело запускать 13b модели. Золотая середина между экономностью ресурсов и "умом"

- 32 Гб ОЗУ - вам уже доступны 20b и 23b модели. Они достаточно умные, чтобы поддержать любой вид диалога и не скатываться в уныние через 150 сообщенийСтепень квантования. Это вот эти Q5_K_M, Q8 и все такое. Чем меньше число после Q, тем более шакальная модель из-за сжатия. Не разбирался, как оно устроено технически, но знайте, что Q5_K_M - золотая середина. Хорошее сжатие, но на качество не влияет.

Размер контекста. Он служит "памятью" для модели. В ней она хранит карточку персонажа, инструкции, а также последние сообщения из диалога между вами и ею. Вот в этом и проблема РП-гейминга с ИИ. Обычно модели поддерживают 4096 токенов контекста. Если персонаж не очень большой, то это где-то 10-15 сообщений в диалоге. Что было написано раньше - ИИ уже "не помнит".

Но если контекста больше, то либо в названии модели это будет указано как *число*k. Например, ,LLaMA-2-7B-32K, либо нужно найти, сколько контекста поддерживает изначальная модель. Например, Mistral NeMo поддерживает до 120к контекста!

Ну и я хотел бы дать список "для старта":

MythoMax-L2-13B-GGUF - Это классика!!! Это знать надо!!! Модель старая, но все еще прекрасная. Она идеально заточена под РП, отвечает хорошо и складно. Умеет как в философские диалоги, так и в хорни

Pantheon-RP-1.5-12b-Nemo-GGUF - по отзывам превосходит MythoMax в понимании ситуаций текста. Отлично поймет, что вы не человек, а русалка (что для моделей очень сложно осознать), и не очень хорни - придется немного поуговаривать. Да, как с настоящей женщиной

MN-12B-Mag-Mell-R1-Q6_K-GGUF - это из новых, на основе Mistral NeMo. Поддерживает до 120к!!! контекста. Но у нее проблема, она очень "добрая". В хорни умеет, но никогда не отказывает, что печально

L3-8B-Lunar-Stheno-GGUF - компактная, умная, хорошо пишет. Что еще нужно для счастья?

Nethena-MLewd-Xwin-23B-GGUF - старая, большая, тяжелая, но очень умная и хорошо пишет. Осторожно - очень хорни, оседлает вас при первом попавшемся случае

MLewd-ReMM-L2-Chat-20B-GGUF - тоже самое. И тоже хорни

Все эти модели хороши по-своему. Тестируйте, смотрите, какая понравится больше.

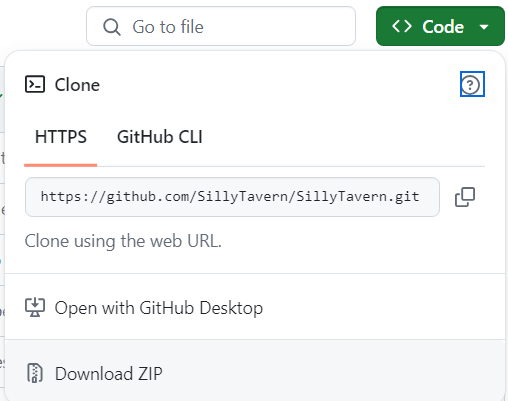

Установка SillyTavern

Вот с ней чуть-чуть сложней, но не намного.

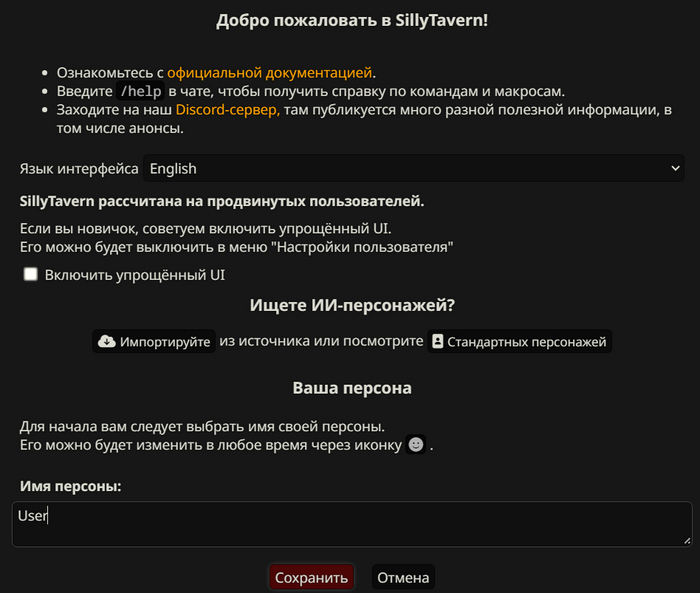

Как оно все установит и запустится, перед вами появится вот такое окошко:

Выбирайте язык интерфейса и вводите имя вашему первому персонажу (которым будете вы).

Более тонкая настройка SillyTavern будет в следующих частях, а пока давайте быстренько приведем его к рабочему виду.

Вас встречает интерфейс! Нужно сделать несколько вещей, чтобы опыт игры был максимально приятным:

Связать CoboldCPP и SillyTavern

ОБЛАКО: подключение Together.AI

Описать своего персонажа

Скачать карточки персонажей для игры

Выбрать пресет генерации

Начнем по порядку.

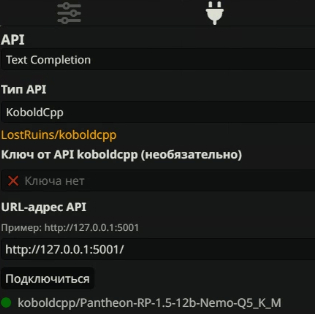

Подключение CoboldCPP и SillyTavern

Сверху будет много вкладок, и вам нужна одна из них, со значком вилки. Выбираете "Тип API" - KoboldCPP и жмите подключиться. Как только чуть ниже появится зеленый кружок с названием модели - Congratulations! Все подключено.

Подключение облака через Together.AI

Тут все еще проще, KoboldCPP не нужон. Регистрируйтесь на Together.AI, и после входа вам покажут ваш API-ключ. Его вводите сюда:

В "Тип AI" выбирайте TogetherAI, вставляйте ключ, и выбирайте модель! Для меня самой лучшей оказалась WizardLM-2.

Напомню, ваш стартовый капитал - пара долларов. Дальше либо регайте новый акк и вписывайте новый ключ, либо ПЛАТИТЕ.

А вот расценки к каждой из моделей. Если используете 70B модель, вам хватит примерно на 3 дня активнейшей игры.

Описание вашего персонажа

Скрывается во вкладке со смайликом. В описании... Просто опишите себя. Возраст, характер, характеристики тела и все такое. Вместо вашего имени пишите {{user}}. Если вы хотите что-то описать с персонажем, с которым будете играть, его указывайте как {{char}}.

Кстати, некоторые модели отлично понимают MBTI. Это типы личности. Можете пройти тест и просто ввести эти 4 буквы в описание персонажа, указав Personality: *ваш тип личности*.

И да, вы можете создать несколько своих личностей, для этого слева есть кнопочка "создать".

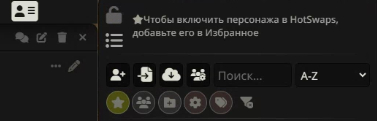

Ищем персонажей

Главный хаб персонажей - chub.ai. Фильтры по жанрам (работают не очень, так как авторы часто забивают на указание тегов), поиск, и все такое. Если кто-то понравился, жмите на персонажа, копируйте ссылку на него, и вставляйте вот тут:

Самая правая вкладка, это ваш список персонажей. Вам нужна иконка с облачком:

Кстати, чуть левее от нее иконка есть с файликом. Это если вы скачали PNG или JSON персонажа

Выбираем пресет генерации

Оно находится в самой левой вкладке

Тут много крутилок и галочек, но вам нужны лишь пресеты. У меня сейчас выбран Mirostat. Просто выбирайте из списка, сохранять ничего не надо. Рекомендую следующие пресеты:

Mirostat

Midnight Enigma

Kobold (GodLike)

Поэкспериментируйте, и оставляйте то, что по вашему мнению лучше пишет для вас.

Ответ в токенах - длина сообщения, которую будет писать ИИ. Выбирайте между 300 и 450. Если меньше, то тупо будет мало текста, а если больше, то будет риск того, что ИИ начнет писать за вас.

Контекст в токенах: Выбирайте 4096, если модель не предполагает большего количества

Как общаться правильно

Тут есть некий синтаксис. Не все модели поголовно его понимают, но большинство - поймут:

*Действие*

"Цитата или мысли"

Просто текст, разговор

[] - инструкции для ИИ, например [двигайся дальше по сюжету]

Как общаться на русском языке

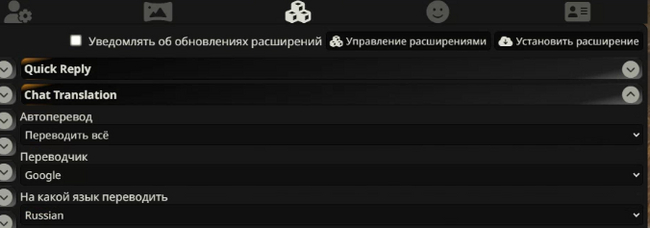

Все просто! Заходите во вкладку с кубами, которая сверху, открывайте вкладочку Chat Translation и выбирайте как на картинке:

А что дальше?

А в целом то и все! Можно общаться со своей вайфу. Вы гарантированно получите какое-то удовольствие от этого.

Этот пост рассчитан на вкат в тему, а дальше начинаются... приколы. Документация толком ничего не объясняет, тема максимально молодая и новая, так что сообщество все еще ищет правильные подходы по созданию персонажей, подбору системных инструкций к ИИ и много много чего еще. Возможно я напишу об этом, когда-нибудь

Мой основной блог тут

Qwen2.5-VL ещё китайская нейронка

Китайцы из Alibaba дропнули ЕЩЁ ОДНУ БЕСПЛАТНУЮ НЕЙРОНКУ.

Qwen2.5-VL умеет:

• Анализировать изображения — понимает, что на пикче

• Распознаёт текст с картинки — дальше с ним можно работать

• Работать с видео длиной до 1 часа

• Писать код

• Перегонять любой документ в HTML

• Подключаться к браузеру и работать с ним — да, как новая фича OpenAI